دیکتاتوری الگوریتمها؛ وقتی «کُدها» جای «قانون» را میگیرند

دیکتاتوری الگوریتمها؛ وقتی «کُدها» جای «قانون» را میگیرند (حکمرانی رسانه – قسمت ۳۸)

مقدمه: قانونگذاران نامرئی

در دنیای فیزیکی، ما میدانیم قانونگذار کیست (مجلس)، مجری کیست (دولت) و قاضی کیست (دادگاه). این ساختارها شفاف و قابل نقد هستند.

اما در دنیای دیجیتال، زندگی ما توسط نیروهایی کنترل میشود که نه آنها را میبینیم، نه میشناسیم و نه به آنها رأی دادهایم. این نیروها «الگوریتمها» هستند.

لارنس لسیگ (Lawrence Lessig)، استاد حقوق دانشگاه هاروارد، دو دهه پیش جملهای تاریخی گفت: «کد، قانون است» (Code is Law).

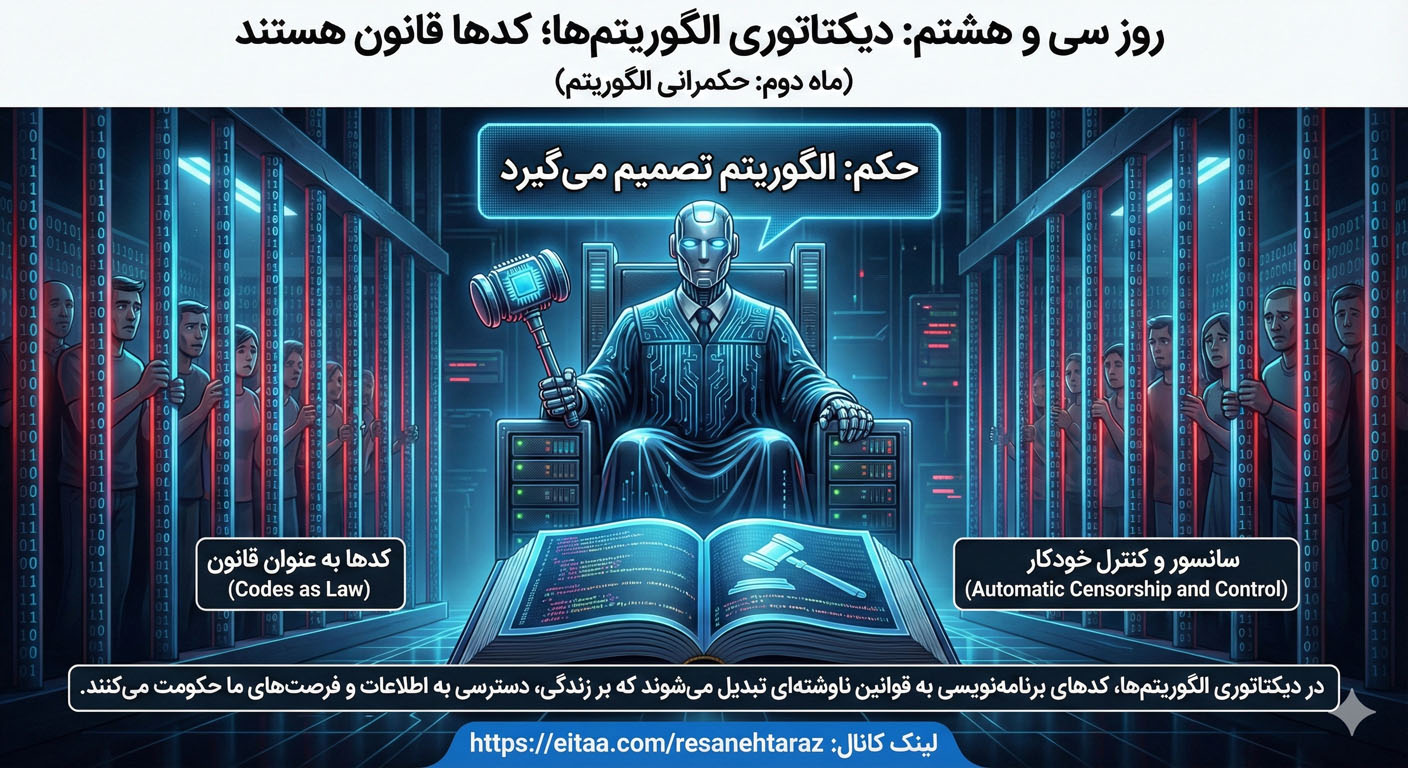

در قسمت سی و هشتم، به بررسی مفهوم «دیکتاتوری الگوریتمها» (Algorithmic Dictatorship) میپردازیم. چگونه چند خط کدِ برنامهنویسی، تعیین میکنند که ما چه ببینیم، چه بخریم، به چه کسی عشق بورزیم و از چه کسی متنفر باشیم؟

الگوریتم چگونه حکومت میکند؟

الگوریتمها صرفاً ابزارهای ریاضی خنثی نیستند؛ آنها «معماریِ انتخاب» ما را میسازند.

قدرت حکمرانی آنها در سه سطح اعمال میشود:

۱. دروازهبانی (Gatekeeping):

الگوریتم تصمیم میگیرد چه محتوایی از دروازه عبور کند و به چشم شما برسد.

- مثال: چرا پستهای مربوط به شهید سلیمانی در اینستاگرام حذف میشود اما پستهای خشونتآمیز دیگر میماند؟ چون «قانونگذارِ الگوریتم» (شرکت متا) اینطور کدنویسی کرده است. این سانسور نرم، قدرتمندتر از سانسور دولتی است چون نامرئی است.

۲. برجستهسازی و دفن کردن (Amplification & Suppression):

الگوریتم تصمیم میگیرد چه چیزی «وایرال» شود.

اگر الگوریتمِ یوتیوب تشخیص دهد که ویدیوهای «تئوری توطئه» نگهداشتِ مخاطبِ بیشتری دارد، آنها را به میلیونها نفر پیشنهاد میدهد. در مقابل، صدای نخبگان و دانشمندان را که محتوای آرامتری دارند، در زیر آوار محتوا دفن میکند. الگوریتمها معمولاً طرفدار «افراطگرایی» هستند، چون افراط هیجان دارد و هیجان یعنی پول.

۳. دستکاری رفتاری (Behavioral Modification):

الگوریتمها با شناخت دقیق روانشناسی شما، در لحظه مناسب، محتوای مناسب را نشان میدهند تا رفتار شما را تغییر دهند (مثلاً ترغیب به رأی ندادن یا خرید یک کالای خاص).

جعبه سیاه: مشکلِ عدم شفافیت

بزرگترین چالش حکمرانی این است که این الگوریتمها «جعبه سیاه» (Black Box) هستند.

هیچکس (حتی دولتها) دقیقاً نمیداند که الگوریتم تیکتاک یا اینستاگرام چگونه کار میکند. آنها این فرمولها را «اسرار تجاری» میدانند.

این عدم شفافیت باعث میشود که تبعیضهای نژادی، جنسیتی و سیاسی در دلِ کدها پنهان شود. مثلاً ممکن است الگوریتم استخدام، زنان را رد کند چون با دادههای مردسالارانه آموزش دیده است، و هیچکس هم متوجه نشود چرا.

راهکار حکمرانی: حسابرسی الگوریتم (Algorithm Audit)

ما نمیتوانیم اجازه دهیم زندگی شهروندانمان توسط کدهای مخفیِ شرکتهای خارجی اداره شود.

حکمرانی مدرن رسانه به دنبال «حقِ توضیح خواستن» (Right to Explanation) است.

- پلتفرمها باید توضیح دهند چرا این پست را حذف کردند؟

- چرا این محتوا را به من پیشنهاد دادند؟

- نهادهای نظارتی باید حق داشته باشند کدهای حساس را «حسابرسی» کنند تا مطمئن شوند علیه امنیت ملی یا حقوق شهروندی عمل نمیکنند.

نتیجهگیری

ما از استبدادِ پادشاهان خلاص نشدیم تا گرفتارِ استبدادِ برنامهنویسانِ سیلیکونولی شویم.

آگاهی از اینکه «آنچه در فیدِ گوشی میبینم، انتخابِ من نیست، بلکه انتخابِ الگوریتم برای من است»، اولین گام برای رهایی از این دیکتاتوری نامرئی است. ما باید سوادِ الگوریتمی (Algorithmic Literacy) خود را بالا ببریم.